ChatGPTをはじめとする生成AIツールが企業に急速に浸透する中、業務効率化の恩恵を受ける一方で、思わぬリスクに直面するケースが増えています。

実際、サムスン電子では従業員がソースコードを生成AIに入力し外部流出する事態が発生しました。情報漏洩だけでなく、著作権侵害や誤った判断による業務ミス、差別的な表現の出力など、AIならではの問題が顕在化しつつあります。

この記事では、企業が直面する生成AIの5大リスクとその具体的な対策、AIガバナンス体制の構築方法、さらにEU AI規制法や日本における最新の動向まで、実務に即した形で網羅的に解説していきます。

生成AIの5大リスクとは何か

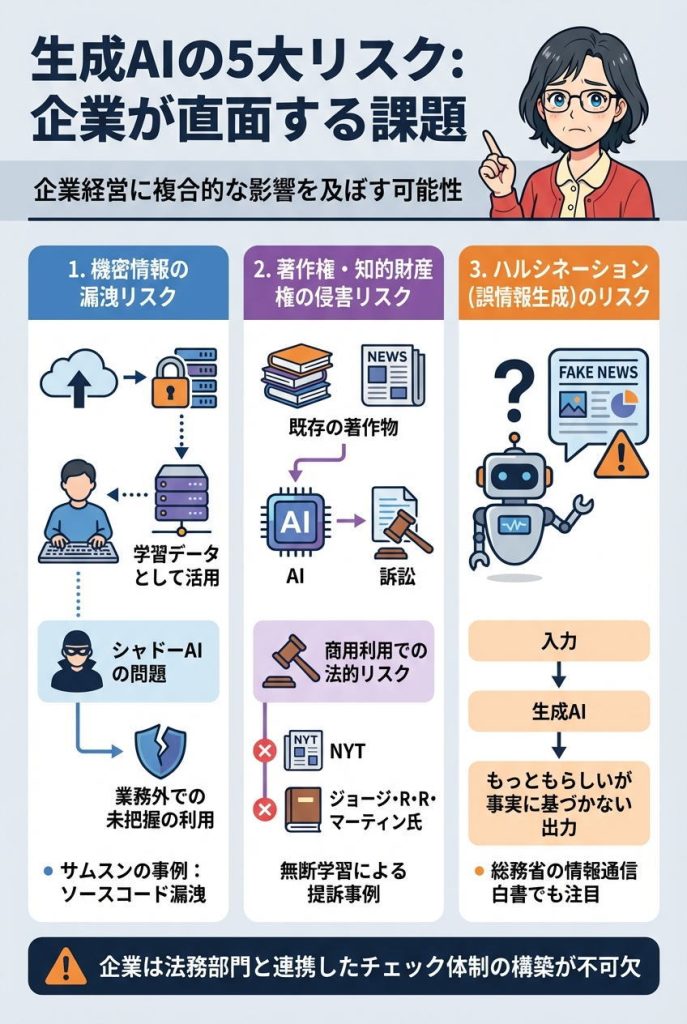

企業が生成AIを活用する際、必ず意識すべき主要なリスクが5つ存在します。これらのリスクは単独で発生するだけでなく、複合的に企業経営に影響を及ぼす可能性があります。

機密情報の漏洩リスク

生成AIサービスに入力した情報は、基本的にクラウド上で保管され、AIの学習データとして活用される可能性があります。従業員が顧客情報や社内の技術情報、財務データなどを何気なく入力してしまうと、サービス提供者のサーバーに残り、将来的に他のユーザーへの回答に反映される危険性があるのです。

実際、サムスン電子では従業員がChatGPTに社内ソースコードをアップロードし、外部サーバーに保存されたデータが他のユーザーに開示される事態が発生しました。この事例を受け、同社は生成AIツールの使用を全面的に禁止する新ポリシーを策定せざるを得なくなりました。

さらに深刻なのは、組織のガバナンス外で従業員が個人的に生成AIを使用する「シャドーAI」の問題です。企業が把握していないところで業務データが処理され、知らぬ間に情報漏洩やコンプライアンス違反が生じるケースも報告されています。

著作権・知的財産権の侵害リスク

生成AIが出力する文章、画像、コードなどには、学習時に取り込んだ既存の著作物の特徴が反映されている場合があります。企業がこれらの生成物を商用利用した際、元の著作権者から訴訟を起こされるリスクを抱えることになるのです。

ニューヨーク・タイムズは、ChatGPTが許可なく同紙の記事を利用し、購読料収入および広告収入の機会を奪っているとして、OpenAIとMicrosoftに対し数十億ドル規模の損害賠償を求める訴訟を提起しました。また、「ゲーム・オブ・スローンズ」の作者ジョージ・R・R・マーティン氏を含む作家たちも、自身の著作物が無断で学習に使用されたとしてOpenAIを訴えています。

こうした訴訟リスクは、生成AIを業務で活用するすべての企業に潜在的に存在しており、法務部門と連携したチェック体制の構築が不可欠です。

ハルシネーション(誤情報生成)のリスク

ハルシネーションとは、生成AIが事実に基づかない情報をもっともらしく出力する現象を指します。

総務省の情報通信白書でも、生成AIによって顕在化したリスクとして特に注目されている課題です。

例えば、法的な契約書作成において誤った法的解釈を含む文書が作成されたり、技術提案資料で存在しない製品仕様やデータが記載されたりするケースがあります。高度な専門性を要する分野や定量データの計算において、ハルシネーションは特に多く見られる傾向にあります。

企業の意思決定や顧客対応に誤った情報が使用されれば、経済的損失だけでなく、顧客や取引先からの信頼を大きく損なう結果につながります。行政文書や提案資料など正確性が重視される場面では、必ず人の手による検証と事実確認のプロセスを組み込む必要があります。

バイアス・差別表現のリスク

生成AIは、インターネット上の大量データを学習しているため、その中に含まれる偏見や差別的な表現を引き継ぐ可能性があります。人種、性別、年齢、国籍などに関するステレオタイプな表現が出力されることで、企業の倫理観や公平性に対する社会的信頼が損なわれるリスクが存在します。

実際、採用活動でAIを活用した企業では、特定の属性を持つ応募者に不利な評価を下すバイアスが問題となった事例があります。融資の与信判定や医療診断支援など、人の人生に直接的な影響を与える領域でバイアスのある判断が行われた場合、法的責任を問われる可能性も高まります。

データの元になっている社会構造自体に不公平なバイアスがあると、それを学習したAIが差別的な構造を再生産してしまう仕組みを理解し、出力内容のチェック体制を整えることが重要です。

セキュリティ攻撃のリスク

生成AI特有のセキュリティ脅威として、「プロンプトインジェクション」があります。これは、AIに対して悪意ある特殊な命令を入力することで、開発者が意図しない挙動をさせたり、本来秘匿すべき情報を出力させたりする攻撃手法です。

2023年2月には、米国の大学生がMicrosoftのBing検索エンジンに搭載された生成AIに対してプロンプトインジェクションを行い、非公開の指示や開発用コードネームを引き出すことに成功した事例が報告されています。

さらに、生成AIを悪用した高度なサイバー攻撃も増加しています。攻撃者は生成AIを使って、本物と見分けがつきにくい偽メールや自然な日本語の詐欺コンテンツを低コストで大量作成できます。本物そっくりの音声や映像を作り出すディープフェイクによる詐欺のリスクも高まっており、企業は技術的な対策だけでなく、従業員教育を含めた総合的なセキュリティ対策が求められています。

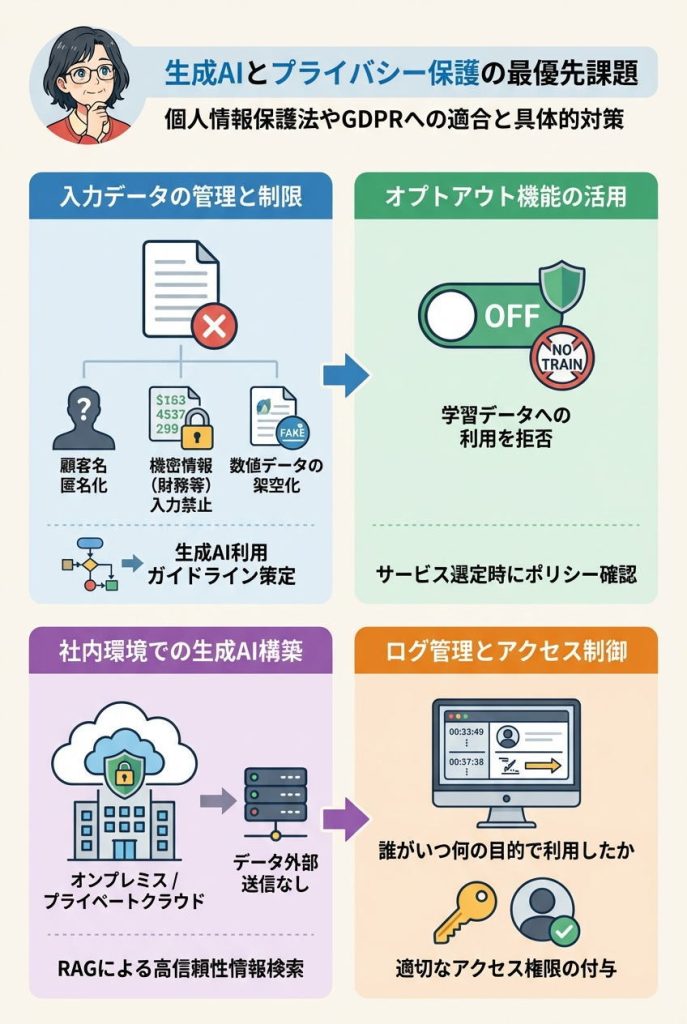

プライバシー保護の重要性と具体的対策

生成AIの活用において、個人情報やプライバシーの保護は最優先課題のひとつです。特に欧州のGDPRや日本の個人情報保護法など、法的規制への適合が求められる中、企業は具体的な保護策を講じる必要があります。

入力データの管理と制限

まず基本となるのは、生成AIに入力してよい情報の範囲を明確に定義することです。顧客の氏名、住所、クレジットカード情報などの個人情報、社内の技術仕様、財務データ、契約内容といった機密情報は、原則として外部の生成AIサービスに入力してはなりません。

企業は「生成AI利用ガイドライン」を策定し、入力可能な情報と禁止事項を具体的に列挙する必要があります。例えば、「顧客名は匿名化する」「社内プロジェクトのコードネームを使わない」「数値データは架空のものに置き換える」といった実務レベルの指針を示すことで、従業員が迷わず判断できる環境を整えます。

オプトアウト機能の活用

多くの生成AIサービスには、入力したデータを学習に利用されないようにする「オプトアウト」機能が用意されています。ChatGPTの有料版では、設定画面から学習データへの利用を拒否できる機能があり、これを有効化することで情報漏洩リスクを大幅に軽減できます。

ただし、すべてのサービスがオプトアウトに対応しているわけではなく、無料版では利用できない場合もあります。サービス選定の段階で、データ取り扱いポリシーやオプトアウト機能の有無を確認し、企業のセキュリティ要件に合致するツールを選択することが重要です。

社内環境での生成AI構築

より高度なプライバシー保護が必要な企業では、社内または閉域ネットワーク上に独自の生成AI環境を構築する選択肢もあります。オンプレミス型やプライベートクラウド型の生成AIであれば、データが外部サーバーに送信されることなく、完全に企業の管理下で処理できます。

NTT東日本の「生成AIサービス」のようなSaaS型ソリューションでは、社内データを活用したチャット型AIアシスタントやRAG(Retrieval-Augmented Generation)の構築が可能です。外部のデータベースから信頼性の高い情報を検索して回答を生成する仕組みにより、ハルシネーションのリスクも低減できます。

ログ管理とアクセス制御

誰がいつ何の目的で生成AIを利用したのか、入力内容と出力結果を記録するログ管理の仕組みも不可欠です。問題が発生した際の追跡調査や、不適切な利用の早期発見に役立ちます。

また、部署や役職に応じてアクセス権限を設定し、必要最小限の範囲でのみ生成AIを利用できるようにすることで、リスクを分散できます。特に機密性の高いプロジェクトに関わる従業員には、より厳格な利用制限と監視体制を適用するなど、段階的なアプローチが有効です。

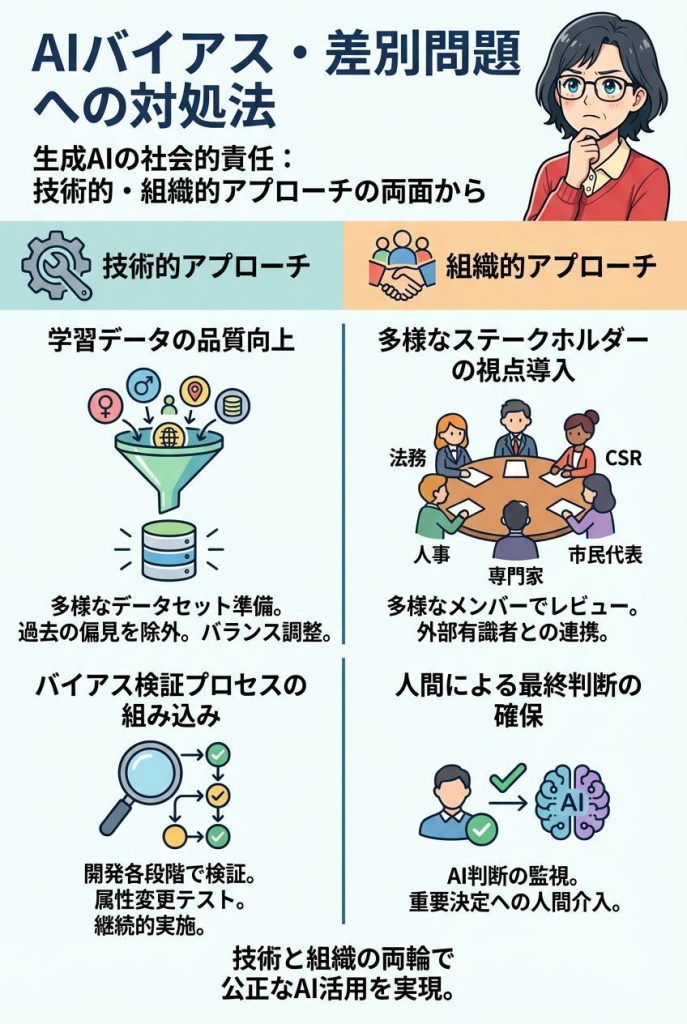

バイアス・差別問題への対処法

生成AIが出力する差別的な表現やバイアスを含む判断は、企業の社会的責任に直結する重大な問題です。これらを防ぐためには、技術的対策と組織的対策の両面からアプローチする必要があります。

学習データの品質向上

バイアスの根本原因は、AIが学習するデータそのものに存在します。学習データのボリュームが少なく、内容に偏りがある場合、AIの出力も偏ったものになります。そのため、多様性のあるデータセットを用意し、特定の属性に偏らないバランスの取れた学習環境を整えることが第一歩です。

データ収集の段階で、性別、年齢、人種、地域などの属性が偏っていないか検証し、必要に応じて補正データを追加します。また、過去のデータには当時の社会的偏見が反映されている可能性があるため、現代の倫理基準に照らして不適切な表現を除外する作業も欠かせません。

バイアス検証プロセスの組み込み

AI開発・導入の各段階でバイアスを検証するプロセスを組み込みます。具体的には、開発段階でのテストケース作成時に、性別や人種などの属性を変えた場合に出力結果がどう変化するかを確認します。

例えば、採用支援AIであれば、同じスキルセットを持つ男性応募者と女性応募者で評価が異なっていないか、特定の大学出身者が優遇されていないかといった観点でチェックします。融資判定AIであれば、年齢や居住地域によって不当に低い評価が出ていないか検証します。

バイアス検証は一度実施すれば終わりではなく、AIモデルの更新や新たな学習データの追加のたびに継続的に実施する必要があります。

多様なステークホルダーの視点導入

技術チームだけでバイアス対策を検討すると、見落としが生じる可能性があります。そこで、法務部門、人事部門、CSR担当者、外部の倫理専門家など、多様な視点を持つメンバーで構成されるレビュー体制を整えることが重要です。

社外の有識者や市民代表を交えた検討会を定期的に開催し、AIの出力内容や判断基準について意見交換する場を設けることも効果的です。内部では気づかなかった差別的な表現や不公平な判断を、外部の視点から指摘してもらうことで、より公正なAI活用が実現します。

人間による最終判断の確保

どれだけ技術的に優れたAIでも、完全にバイアスを排除することは困難です。そのため、特に人の人生に大きな影響を与える判断においては、AIの提案を参考にしつつも、最終的な決定は人間が行うという原則を守る必要があります。

採用の合否判定、融資の可否、医療診断の確定などでは、AIの出力結果をそのまま採用するのではなく、専門知識を持つ担当者が内容を精査し、倫理的・法的に問題がないか確認してから決定を下すプロセスを確立します。

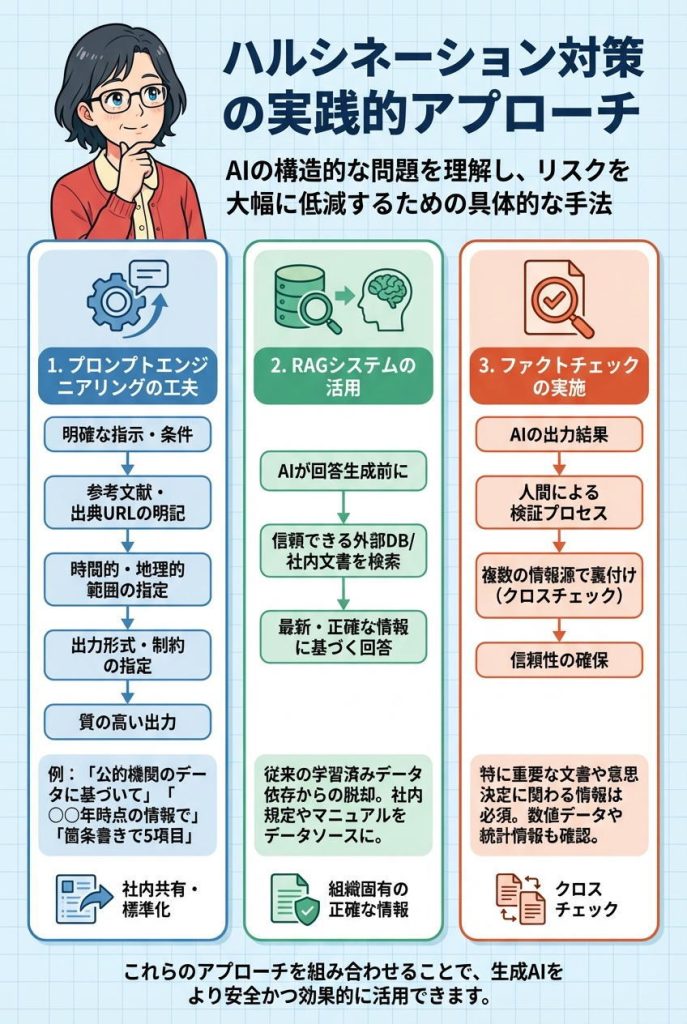

ハルシネーション対策の実践的アプローチ

ハルシネーションは生成AIの構造的な特性に起因する問題であり、完全に防ぐことは現時点では困難です。しかし、適切な対策を講じることで、リスクを大幅に低減できます。

プロンプトエンジニアリングの工夫

生成AIの出力精度は、どのように指示(プロンプト)を出すかに大きく左右されます。曖昧な指示では誤情報が出力されやすくなるため、明確な条件や目的をプロンプトに加えることが重要です。

効果的なプロンプトの例としては、「参考文献を明記してください」「公的機関のデータに基づいて回答してください」「出典URLを含めてください」といった指示を付け加える方法があります。また、「〇〇年時点の情報」「日本国内の法律に基づいて」など、時間的・地理的な範囲を明示することで、より正確な回答を得られます。

出力形式や言い回しを具体的に指定することも有効です。「箇条書きで5項目」「各項目300字以内」といった制約を設けることで、AIの出力をコントロールしやすくなります。プロンプトエンジニアリングの知識を社内で共有・標準化し、部門ごとの業務に適したテンプレートを用意しておくことで、誰でも質の高い出力を得られる環境を整えられます。

RAGシステムの活用

RAG(Retrieval-Augmented Generation:検索拡張生成)は、ハルシネーション対策として非常に有効な技術です。RAGは、AIが回答を生成する前に、信頼できる外部データベースや社内文書から関連情報を検索し、その情報に基づいて回答を生成する仕組みです。

従来の生成AIは学習済みのデータのみに依存するため、古い情報や不正確な知識に基づいて回答してしまう可能性がありました。しかしRAGを導入することで、最新の正確な情報源を参照しながら回答できるため、ハルシネーションのリスクが大幅に低減します。

企業の社内規定や製品マニュアル、技術文書などをRAGのデータソースとして組み込めば、組織固有の正確な情報に基づいた回答が可能になります。

ファクトチェックの実施

生成AIの出力結果をそのまま信頼するのではなく、必ず人間による検証プロセスを挟むことが不可欠です。特に重要な文書や意思決定に関わる情報については、複数の情報源で裏付けを取る「クロスチェック」を実施します。

数値データや統計情報は公的機関のデータベースで確認する、法律に関する記述は最新の法令を参照する、引用された論文や記事は実際に存在するか確認するといった地道な作業が求められます。

ファクトチェックの責任者を明確にし、チェック項目をリスト化したマニュアルを整備することで、確認漏れを防ぎます。また、外部の専門家によるレビューを受ける体制を整えることも、品質保証の観点から有効です。

複数AIによる相互検証

単一の生成AIに依存するのではなく、複数の異なるAIモデルを併用し、出力結果を比較検証する方法も効果的です。例えば、ChatGPT、Claude、Geminiなど複数のAIに同じ質問をして、回答が一致しているか確認します。

回答に相違がある場合は、その部分について詳しく調査することで、ハルシネーションの可能性がある箇所を特定できます。この相互検証プロセスを業務フローに組み込むことで、誤情報のリスクを最小化できます。

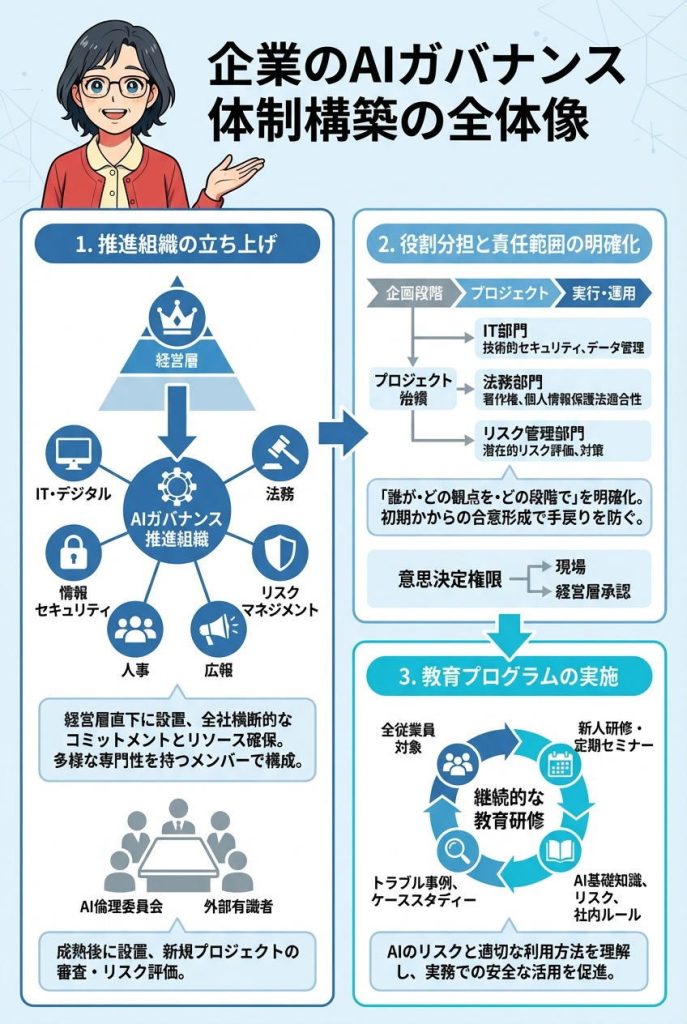

企業のAIガバナンス体制構築の全体像

AIガバナンスは、一部の部門だけの取り組みではなく、全社横断的な体制として構築する必要があります。組織全体でAIのリスクを管理し、倫理的な活用を推進するための枠組みを整えます。

推進組織の立ち上げ

まず、経営層の直下にAIガバナンス推進組織を設置します。経営層の関与は、AIガバナンスの取り組みに対する全社的なコミットメントを示すだけでなく、必要なリソースの確保や意思決定のスピードを高める上でも不可欠です。

推進組織には、IT・デジタル部門、法務部門、リスクマネジメント部門、情報セキュリティ部門、人事部門、広報部門など、多様な専門性を持つメンバーを配置します。部門横断のプロジェクトチームや委員会を設置し、各部門の責任範囲や担当者を明確化することで、責任の所在が曖昧になることを防ぎます。

組織が成熟してくれば、AI倫理委員会を設置し、新規のAIプロジェクトに対する審査やリスク評価を行う体制を構築することも検討します。外部の有識者を委員に招くことで、客観性と専門性を高められます。

役割分担と責任範囲の明確化

AIガバナンスでは、「誰が・どの観点を・どの段階で確認・合意するか」を明確にすることが重要です。例えば、IT部門は技術的なセキュリティとデータ管理を担当し、法務部門は著作権や個人情報保護法への適合性を確認し、リスク管理部門は潜在的なリスクの評価と対策を検討するといった具体的な役割分担を定義します。

プロジェクトの企画段階から各部門代表と経営層が参画し、リスクと対応策について初期から合意形成することで、後工程での手戻りや対策の停滞を防げます。意思決定権限の範囲も明確にし、どのレベルの判断は現場に委ね、どのレベルは経営層の承認が必要かを定めておきます。

教育プログラムの実施

AIガバナンスの実効性を高めるには、組織内の人材がAIのリスクと適切な利用方法を理解していることが前提となります。開発者だけでなく、AIを利用するすべての従業員を対象に、継続的な教育研修を実施します。

新人研修や定期的な社内セミナーで、AIの基礎知識、リスクの種類、社内ルールの内容、実際のトラブル事例などを共有します。実務に即したケーススタディーを組み込むことで、従業員が自分の業務でどのようにAIを安全に活用すべきか具体的にイメージできるようになります。

また、経営層に対しても、AIガバナンスの重要性を理解してもらうための研修を実施します。トップダウンで重要性を発信し続けることが、全社的な取り組みの推進力となります。

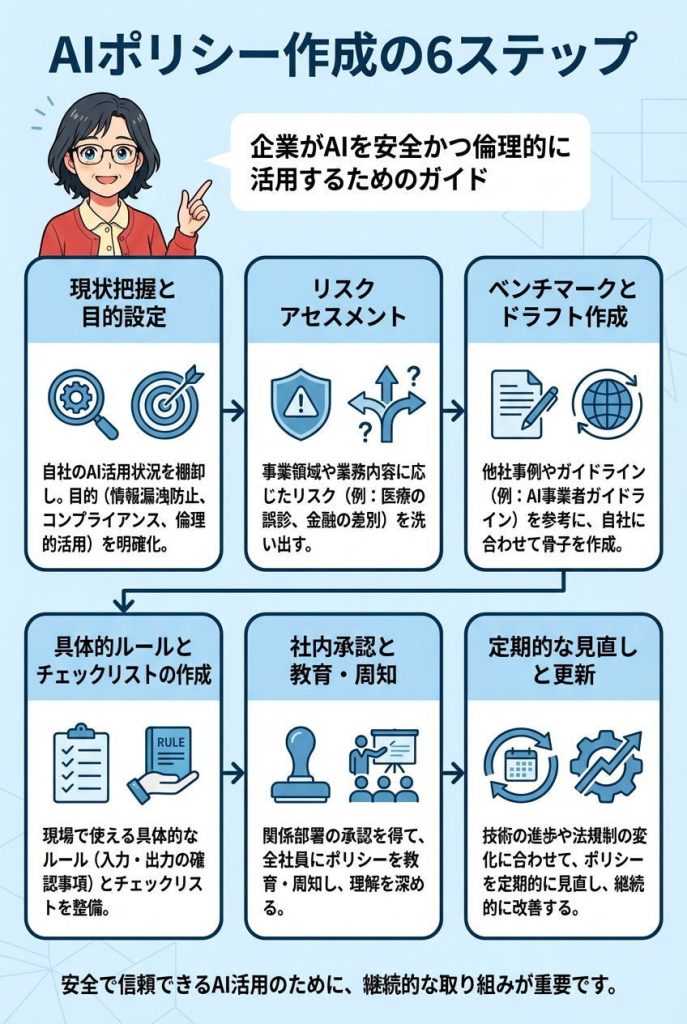

AIポリシー作成の6ステップ

企業がAIを安全かつ倫理的に活用するためには、明文化されたAIポリシーの策定が不可欠です。以下、実務に即した6つのステップを紹介します。

ステップ1:現状把握と目的設定

まず、自社のAI活用の現状を正確に把握します。どの部門でどのようなAIツールが使われているか、または今後導入予定があるかを棚卸しします。シャドーAIの存在も含め、実態を把握することが出発点です。

次に、AIポリシーを策定する目的を明確にします。「情報漏洩の防止」「コンプライアンスの遵守」「倫理的なAI活用の推進」など、自社が最も重視する価値観や解決すべき課題を定義します。

ステップ2:リスクアセスメント

自社の事業領域や業務内容に照らし合わせ、AIの活用によってどのようなリスクが発生しうるかを洗い出します。前述の5大リスクを参考に、自社固有のリスクシナリオを具体的に描きます。

例えば、医療業界であれば患者情報の漏洩や誤診のリスク、金融業界であれば顧客の与信判断における差別のリスク、製造業であれば技術情報の流出リスクといった具合に、業界特性に応じたリスク評価を行います。

ステップ3:ベンチマークとドラフト作成

他社の事例や業界団体が公表しているガイドラインを参考にしながら、自社のAIポリシーの骨子を作成します。日本では、AI事業者ガイドライン(第1.1版)が総務省・経済産業省から公表されており、これをベースに自社の状況に合わせてカスタマイズします。

金融、医療、行政といった特定業界向けのガイドラインが公表されている場合は、それらも参照します。ただし、他社のポリシーをそのまま流用するのではなく、自社の業務実態や企業文化に即した内容にアレンジすることが重要です。

ステップ4:具体的ルールとチェックリストの作成

抽象的な理念だけでは現場で活用されません。「AIに入力してよい情報・してはいけない情報」「AIの出力結果を使用する際の確認事項」「承認が必要な場合の手続き」など、実務レベルで判断できる具体的なルールを記載します。

チェックリスト形式で確認項目をリスト化すると、担当者が漏れなく対策を実施できます。例えば、「個人情報を匿名化したか」「著作権侵害の可能性を確認したか」「複数の情報源で裏付けを取ったか」といった項目を並べます。

ステップ5:社内承認とパブリックコメント

ドラフトが完成したら、関係部門や経営層の承認を得ます。法務部門によるリーガルチェック、情報セキュリティ部門によるセキュリティ要件の確認、現場部門による実用性の検証など、多角的なレビューを経ることで、ポリシーの完成度を高めます。

可能であれば、社内でパブリックコメントを募集し、従業員からの意見や質問を収集します。現場の声を反映することで、実効性の高いポリシーになるだけでなく、従業員の理解と納得感も得られます。

ステップ6:公表と継続的な見直し

完成したAIポリシーは、社内イントラネットや従業員向けポータルサイトに掲載し、全従業員がいつでも参照できるようにします。対外的に公表するかどうかは、企業の戦略によりますが、AI開発企業やAIを組み込んだサービスを提供する企業では、社会的信頼の獲得のために公表するケースが増えています。

AIポリシーは一度作成して終わりではありません。AI技術の進歩、法規制の変化、社会的受容の変化に応じて、定期的に見直しを行います。年に一度の定期レビューに加え、重大なインシデントや新たなリスクが発見された際には臨時で改訂を検討する柔軟な運用が求められます。

EU AI規制法と日本の動向

AIを取り巻く法規制は、世界各国で急速に整備が進んでいます。グローバルに事業を展開する企業にとって、海外の規制動向を把握することは経営リスク管理の観点から不可欠です。

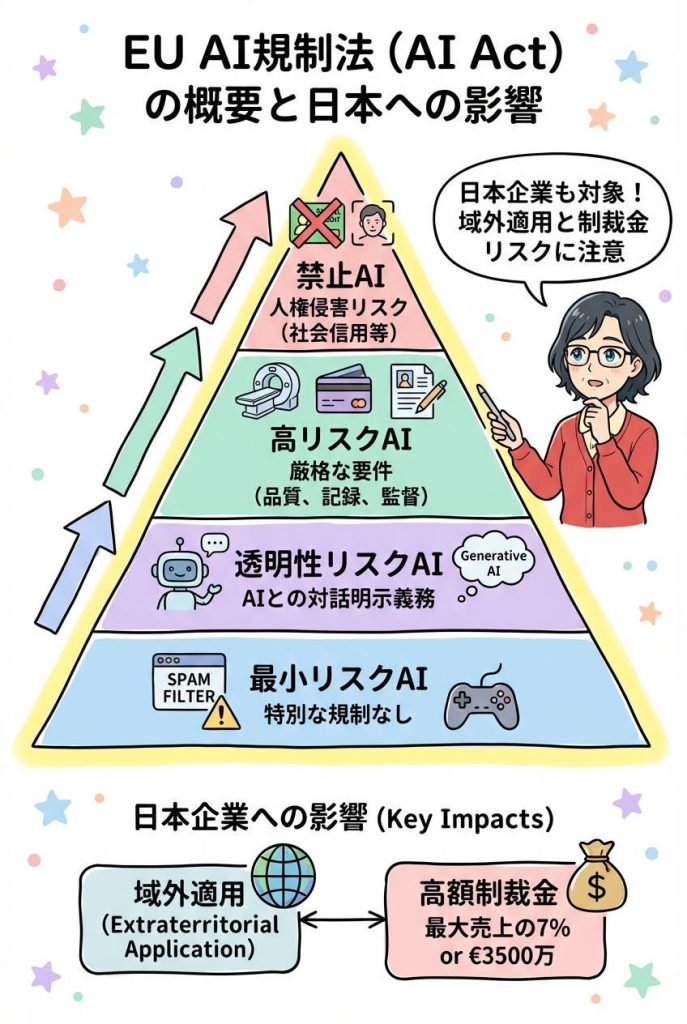

EU AI規制法(AI Act)の概要

EUでは2024年8月にAI規制法(AI Act)が発効し、段階的に適用が開始されています。これは世界で初めてとなる包括的なAI規制法であり、AIのリスクレベルに応じて4つの階層に分類し、それぞれに異なる規制を課す仕組みです。

禁止AIには、社会信用スコアリングシステムや無差別な顔認識システムなど、基本的人権を侵害するリスクの高いAIが含まれます。高リスクAIには、採用、与信判定、医療機器など、人の生活に重大な影響を与えるAIが該当し、データ品質の確保、ログの記録、文書化、人による監督など厳格な要件が課されます。

透明性リスクAIには、チャットボットや生成AIなど、ユーザーがAIと対話していることを明示する義務があります。最小リスクAIは、スパムフィルターやゲームAIなど、リスクが低いため特別な規制は課されません。

EU AI規制法には域外適用の規定があり、EU域内で使用されるAIシステムを提供する日本企業も対象となる可能性があります。違反した場合、最大で全世界年間売上高の7%または3,500万ユーロのいずれか高い方が制裁金として科される可能性があり、企業にとって無視できないリスクです。

日本のAI法と事業者ガイドライン

日本では、2025年5月に「人工知能関連技術の研究開発及び活用の推進に関する法律」(AI法)が成立しました。EUのAI Actのような厳格な規制と罰則を設けるハードロー型ではなく、理念や方向性を示すソフトロー型の法律です。事業者の自主性を重視しながらも、イノベーション促進とリスク対応の両立を図る姿勢が特徴です。

具体的な行動指針としては、総務省・経済産業省が公表した「AI事業者ガイドライン(第1.1版)」があります。このガイドラインは、AI開発者、AI提供者、AI利用者それぞれの立場に応じた推奨事項を示しており、企業が自社のガイドライン策定の際に参照すべき重要な資料となっています。

日本の特徴は、法的拘束力はないものの、政府調達の基準にAIガバナンスの実装状況が組み込まれるなど、実質的にガイドラインの遵守が求められる仕組みになっている点です。デジタル庁が公表する「行政の進化と革新のための生成AIの調達・利活用に係るガイドライン」では、生成AIシステムを調達する際の事業者選定基準の一つとして、AIガバナンスの適用が評価観点に含まれています。

今後の規制動向への備え

AI規制は国際的に整備が進んでおり、今後さらに厳格化する可能性があります。米国でも州レベルでAI規制法案の検討が進んでおり、韓国では「AI基本法」の制定に向けた動きがあります。

企業は、現時点の規制に適合するだけでなく、将来的な規制強化を見据えた体制構築が求められます。国内外の法規制動向を継続的にモニタリングし、自社のAIガバナンスを適宜アップデートしていく仕組みが不可欠です。

法務部門や外部の法律専門家と連携し、最新の規制情報を定期的に収集・分析する体制を整えます。業界団体や専門家団体が開催するセミナーやワークショップに参加し、他社の取り組みや規制当局の考え方を理解することも有効です。

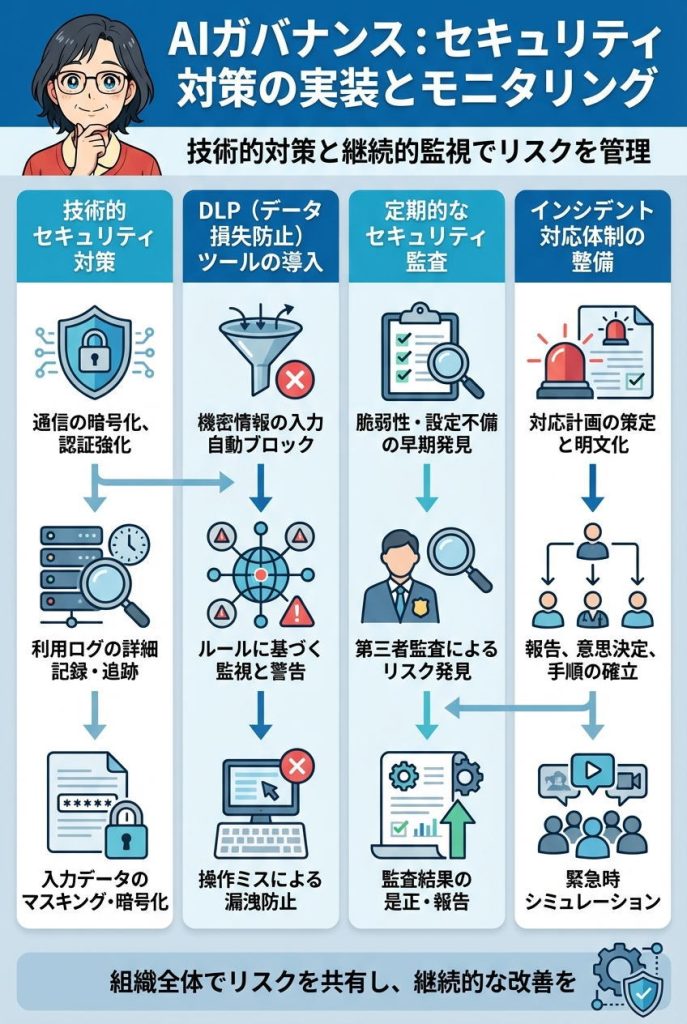

セキュリティ対策の実装とモニタリング

AIガバナンスを形だけで終わらせないためには、技術的なセキュリティ対策の実装と継続的なモニタリングが欠かせません。

技術的セキュリティ対策

まず、生成AIサービスとの通信を暗号化し、データが第三者に傍受されるリスクを防ぎます。社内ネットワークとの連携制限や認証管理の強化により、不正アクセスを防止します。

利用ログを詳細に記録し、誰がいつどのような入力をしたか、どのような出力を得たかをトレース可能にします。これにより、問題発生時の原因究明や、不適切な利用の早期発見が可能になります。

入力データのマスキングや暗号化も有効です。特に個人情報や機密データを扱う場合、データを暗号化してからAIに送信し、処理後に復号化する仕組みを導入することで、万が一データが漏洩した場合でも情報を保護できます。

DLP(データ損失防止)ツールの導入

Data Loss Prevention(DLP)ツールを活用することで、機密情報が生成AIに入力されることを自動的にブロックできます。DLPは、メールやWebアクセス、ファイル操作などを監視し、事前に定義したルールに基づいて機密情報の送信を防止します。

例えば、クレジットカード番号のパターンや社内の機密指定キーワードが入力されようとした際に警告を表示したり、送信を自動的にブロックしたりする設定が可能です。従業員の操作ミスによる情報漏洩を技術的に防ぐ有力な手段となります。

定期的なセキュリティ監査

AIシステムのセキュリティ状態を定期的に監査し、脆弱性や設定の不備を早期に発見します。外部のセキュリティ専門家による第三者監査を受けることで、内部では気づかなかったリスクを発見できる可能性があります。

監査の結果、問題が発見された場合は速やかに是正措置を講じ、必要に応じてAIポリシーやセキュリティ対策を見直します。監査結果は経営層に報告し、組織全体でリスク管理の状況を共有します。

インシデント対応体制の整備

万が一、情報漏洩や不適切な出力による問題が発生した場合に備え、インシデント対応計画を策定しておきます。誰に報告し、誰が意思決定し、どのような手順で対応するかを明文化します。

顧客や取引先への通知、監督官庁への報告、メディア対応など、緊急時の行動をあらかじめシミュレーションしておくことで、実際のインシデント発生時に迅速かつ適切に対応できます。

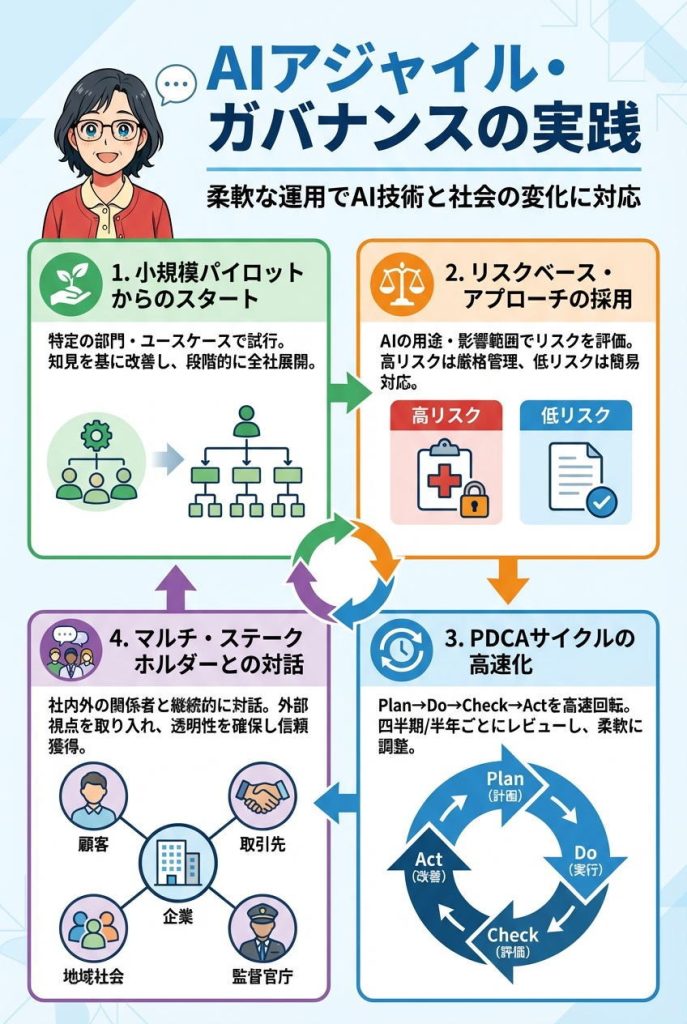

アジャイル・ガバナンスの実践

AI技術と社会の変化のスピードに対応するためには、ガバナンスそのものを柔軟に運用する「アジャイル・ガバナンス」のアプローチが有効です。

小規模パイロットからのスタート

AIガバナンスの構築は、最初から完璧を目指すのではなく、小規模なパイロットプロジェクトから始めることが推奨されます。特定の部門や限定的なユースケースでガバナンスの仕組みを試行し、そこで得られた知見をもとに改善を重ねながら、徐々に全社展開していくアプローチです。

専任組織を設けるのではなく、各部門から兼任のメンバーを集めて柔軟なグループを構成し、既存のリスク管理の枠組みを拡張する形で導入することで、現場に即した実効性の高い仕組みを築けます。

リスクベース・アプローチの採用

すべてのAIに一律の厳格な管理を課すと、現場の負担が過大になり、イノベーションを阻害する可能性があります。そこで、AIの用途や影響範囲に応じてリスクの大きさを評価し、リスクの高い領域には重点的な管理を行い、リスクの低い領域には簡易な対応で済ませる「リスクベース・アプローチ」を採用します。

例えば、医療診断支援や融資の与信判定に用いるAIは高リスクと位置づけて厳格な管理を行い、社内の議事録要約や翻訳支援など影響範囲が限定的なAIは簡易な確認で済ませるといった具合です。

PDCAサイクルの高速化

アジャイル・ガバナンスの核心は、Plan(計画)→Do(実行)→Check(評価)→Act(改善)のサイクルを高速で回し続けることです。四半期ごと、または半年ごとに定期的なレビューを実施し、ガバナンスの実効性を評価します。

新たなリスクが発見された場合や、AI技術に大きな変化があった場合には、臨時でルールの見直しを行います。外部環境の変化に応じて、ゴール設定から体制、運用プロセスまで柔軟に調整していく姿勢が求められます。

マルチ・ステークホルダーとの対話

社内の関係者だけでなく、顧客、取引先、地域社会、監督官庁など、多様なステークホルダーとの対話を継続的に行うことも重要です。外部の視点を取り入れることで、企業内部では気づかなかったリスクや改善点を発見できます。

定期的な検討会や意見交換会を開催し、AIの活用状況や課題について透明性を持って情報共有することで、社会的信頼の獲得にもつながります。

実効性を高めるためのポイント

最後に、AIガバナンスを形骸化させず、実効性のある取り組みとするためのポイントを整理します。

経営層のコミットメント

AIガバナンスの成否は、経営層がどれだけ本気で取り組むかにかかっています。経営層がAIリスク管理の重要性を定期的に発信し、必要なリソースを確保し、各部門の活動を後押しすることで、全社的な推進力が生まれます。

AIガバナンスに関する重要な意思決定には経営層が直接関与し、トップダウンとボトムアップの両面から取り組みを進めることが理想です。

現場実務との整合性

ガバナンスのルールが現場の実務と乖離していると、形だけのものになり機能しません。規定類を作成する際には、現場担当者へのヒアリングや業務観察を通じて実態を把握し、実務に即したルールや手順を設計します。

「何を」「どのように」実施すればよいかを具体的に示し、担当者が迷わず判断できるマニュアルやチェックリストを整備することで、ガバナンスが日常業務に定着します。

継続的な教育と啓発

一度研修を実施しただけでは、従業員のリテラシーは定着しません。定期的な勉強会や社内イベントでAIのリスクとガバナンスの事例を紹介し、最新の動向や社内ルールの変更点を共有し続けることが重要です。

実際に起きたインシデントや他社の失敗事例を教材として活用することで、従業員の危機感とスキルをアップデートできます。

モニタリングとフィードバック

AIプロジェクトごとにリスク評価とモニタリングを実施し、その結果を現場にフィードバックする仕組みを運用手順として定着させます。実施状況や改善結果を定期的に経営層と関係部門に報告し、形だけの会議体やルールにならないよう継続的に管理します。

問題が発見された場合は速やかに是正措置を講じ、必要に応じてルールやプロセスを改訂します。改善のサイクルを回し続けることで、ガバナンスの質が継続的に向上します。

生成AIは、業務効率化や新たな価値創造の強力なツールである一方、情報漏洩、著作権侵害、ハルシネーション、バイアス、セキュリティ攻撃といった多様なリスクを内包しています。

これらのリスクを適切に管理し、AIを安全かつ倫理的に活用するためには、企業が主体的にAIガバナンス体制を構築することが不可欠です。

AIガバナンスは一度構築すれば完了するものではなく、技術の進化、法規制の変化、社会的受容の変化に応じて、継続的に見直し、改善していく必要があります。経営層のコミットメント、部門横断の推進体制、具体的なAIポリシーの策定、従業員教育、技術的セキュリティ対策、そしてアジャイルな運用サイクルを組み合わせることで、実効性のあるガバナンスが実現します。

EU AI規制法や日本のAI法といった法規制の整備も進んでおり、企業はこれらの動向を注視しながら、先回りした対応を進めることが求められています。AIのリスクを正しく理解し、適切なガバナンス体制を整えることで、企業は社会からの信頼を獲得し、持続的な競争力を維持できるのです。